A crescente presença da inteligência artificial (IA) em nosso cotidiano traz consigo diversas possibilidades e benefícios. No entanto, é crucial que a sociedade na totalidade considere não apenas a eficiência e o desempenho dos sistemas de IA, mas também suas implicações éticas e sociais.

Principalmente nas áreas de saúde, justiça e educação, é preciso pensar em como diminuir os riscos da aplicação da tecnologia para preservar a integridade humana. Os algoritmos e sistemas de lógica conseguem desenvolver tarefas simples e elaboradas, mas precisam ser utilizados com cautela.

A ética, nesta situação, diz respeito a princípios e diretrizes que devem ser seguidos ao projetar, desenvolver e implementar a IA. Como a tecnologia em si não possui ética, é fundamental que os profissionais considerem os valores morais e as normas que orientam as ações humanas ao lidar com os sistemas.

Quando utilizada com responsabilidade, a IA pode trazer uma série de benefícios, como a automação de tarefas, a previsão de comportamentos e a tomada de decisões. Contudo, é essencial garantir que esses benefícios sejam distribuídos e que não prejudiquem grupos sociais específicos.

Desafios éticos da inteligência artificial

Um dos principais desafios éticos da IA é o viés algorítmico. Os sistemas são frequentemente treinados com conjuntos de dados que refletem os preconceitos existentes na sociedade, o que pode resultar em discriminação e desigualdade.

Além disso, questões relacionadas à privacidade e segurança também são relevantes. A vida conectada disponibiliza milhões de dados por dia que podem ser usados para compor o repertório dos sistemas artificiais. Isso coloca em risco a intimidade das pessoas e a própria integridade delas.

Há ainda uma preocupação fundamental relativamente à responsabilidade. Percepções enganosas podem ocorrer com o uso da tecnologia, já que ela é testada e desenvolvida por humanos que cometem erros. Por isso, em situações de risco, como na área médica, não é possível permitir que uma IA dê respostas e diagnósticos. Ela pode colaborar, mas não ser responsabilizada.

O mesmo ocorre no caso de direitos autorais, já que a IA funciona basicamente a partir da combinação de elementos já existentes. Ao utilizar uma elaboração artificial, é preciso ter certeza de que os dados não estão a ser replicados. Ainda, outro problema é que algo criado de maneira artificial não pertence, integralmente, à pessoa que a solicitou, envolvendo uma distinção ética de propriedade.

Diretrizes para uma IA responsável

Para mitigar os desafios éticos associados à IA, é fundamental seguir diretrizes claras e transparentes. Isso inclui a documentação do uso de sistemas, de modo a evitar decisões injustas e arbitrárias, e a obtenção de consentimento das pessoas que serão impactadas.

Também é necessário analisar os dados para evitar vazamento de informações pessoais e para identificar perspectivas parciais. Outro ponto fundamental é a colaboração entre os profissionais que desenvolvem os sistemas e especialistas em ética e pesquisadores.

Para implementar a tecnologia de forma ética no ambiente profissional, diversos estudos se preocupam em desenvolver uma regulamentação. Algumas pesquisas, por exemplo, de mestrado, indicam alguns pontos essenciais para uma aplicação responsável e justa da IA.

Os sistemas artificiais apresentam oportunidades reais para o avanço da sociedade, mas promovem desafios para quem os utiliza e pode sofrer seus impactos. Ao adotar uma abordagem ética para o desenvolvimento e a implementação da tecnologia, é possível garantir que ela seja utilizada de forma responsável e benéfica para todos.

Inscreva-se em nosso novo canal do YouTube ACESSE AQUI!

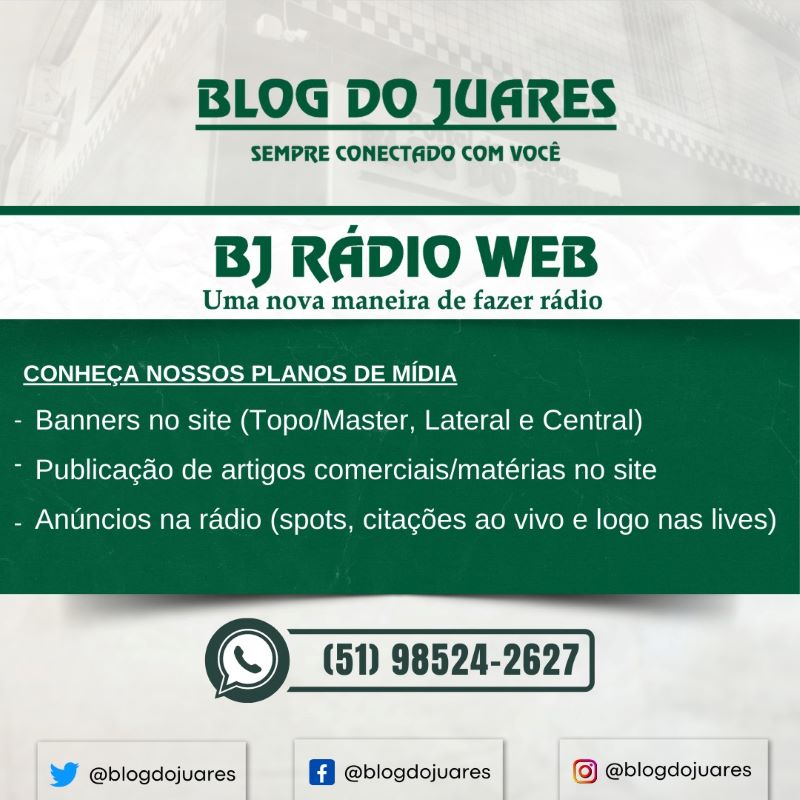

Para receber as notícias gratuitamente e em tempo real participe do nosso super grupo no WhatsApp, clicando aqui!

Ou participe do nosso grupo no Telegram clicando aqui!

Ouça AQUI a web rádio do Blog do Juares!

Siga o Blog do Juares no Google News e recebe notificações das últimas notícias em seu celular, acessando aqui!